なぜAI倫理が重要なのか

AIは強力なツールですが、使い方を誤れば差別を助長したり、プライバシーを侵害したり、人々の仕事を奪ったりする可能性があります。AI倫理とは、AIを開発・利用する際に守るべき道徳的な指針です。

AI倫理が求められる背景

- AIによる採用選考で特定の属性が不利になった事例

- 顔認識AIが特定の人種で誤認識率が高かった問題

- AIが生成したフェイクニュースの拡散

- AIによる監視社会への懸念

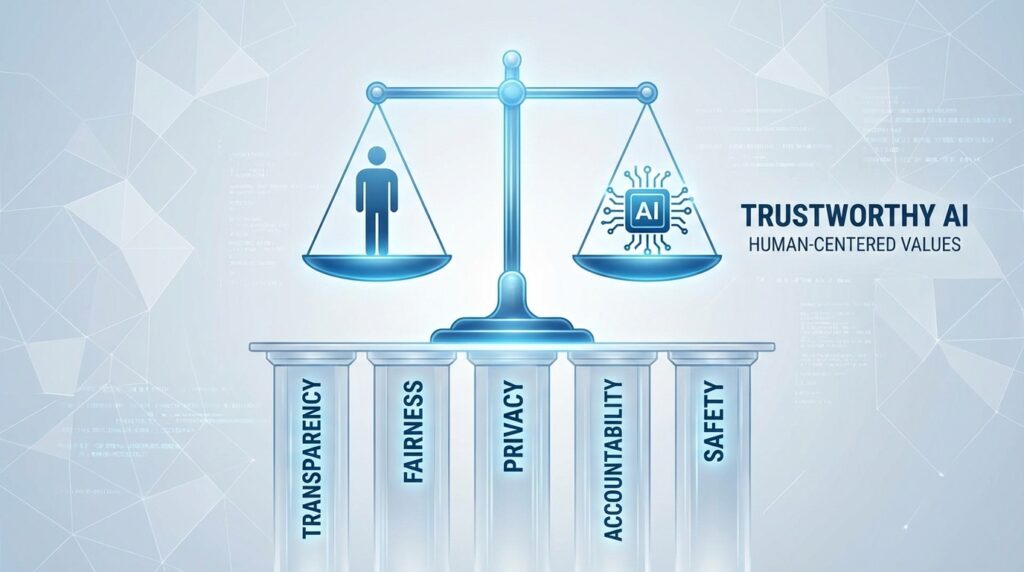

HAIIAでは、すべての人がAIを「健全に」活用するために、AI倫理5原則を提唱しています。

AI倫理5原則

第1原則:人間中心(Human-Centered)

定義:AIは人間の幸福と権利を最優先に設計・運用されるべきである。

実践のポイント:

- AIの判断を最終決定としない。人間が最終判断を行う

- AIに任せきりにせず、人間の監督を維持する

- AIが人間の能力を「代替」するのではなく「拡張」する使い方を選ぶ

具体例

⭕ 良い例:AIが書いた文章を人間がチェック・編集してから公開する

❌ 避けるべき例:AIが生成したコンテンツを無確認で大量公開する

第2原則:公平性(Fairness)

定義:AIは特定の個人や集団を不当に差別してはならない。

実践のポイント:

- AIの出力に偏りがないか意識的にチェックする

- 多様な視点からAIの回答を検証する

- AIが学習したデータに偏りがある可能性を認識する

具体例

⭕ 良い例:AIが作成した採用基準案を、ダイバーシティの観点から人間がレビューする

❌ 避けるべき例:AIの推薦結果をそのまま採用判断に使う

第3原則:透明性(Transparency)

定義:AIがどのように判断したかを説明できるようにすべきである。

実践のポイント:

- AIを使用していることを適切に開示する

- AIの回答の根拠を確認・記録する

- 「なぜその結論になったか」を説明できるようにする

具体例

⭕ 良い例:「この文章はAIを活用して作成し、専門家が監修しました」と明記

❌ 避けるべき例:AI生成コンテンツを人間が書いたように偽装する

第4原則:安全性(Safety)

定義:AIは人間や社会に害を与えないよう設計・運用されるべきである。

実践のポイント:

- AIの出力を重要な判断に使う前に検証する

- 個人情報や機密情報をAIに入力しない

- AIの誤りが重大な結果につながる領域では特に慎重に

具体例

⭕ 良い例:医療情報についてはAIの回答を参考程度にとどめ、専門家に相談する

❌ 避けるべき例:AIの診断結果を鵜呑みにして自己判断で治療する

第5原則:責任(Accountability)

定義:AIの利用結果に対して、人間が責任を持つべきである。

実践のポイント:

- 「AIが言ったから」は言い訳にならない

- AIを使った成果物の最終責任は人間にある

- 問題が起きたときの対応体制を整えておく

具体例

⭕ 良い例:AIを活用した企画書でも、提出者として内容の責任を持つ

❌ 避けるべき例:ミスが見つかったとき「AIのせいです」と責任転嫁する

日常での実践方法

5原則チェックリスト

AIを使う前に、以下の質問を自分に問いかけてみましょう:

| 原則 | チェック質問 |

|---|---|

| 人間中心 | 最終判断は人間が行っているか? |

| 公平性 | 特定の人や集団を不当に扱っていないか? |

| 透明性 | AIを使っていることを適切に開示しているか? |

| 安全性 | AIの出力を検証したか?機密情報を入れていないか? |

| 責任 | 結果に対して責任を持てるか? |

組織でのAI倫理推進

3つのステップ

- ガイドラインの策定:組織としてのAI利用ルールを明文化する

- 教育・研修の実施:全社員がAI倫理を理解できるよう研修を行う

- 定期的な見直し:技術の進歩に合わせてルールを更新する

HAIIAでは、組織向けのAI倫理研修プログラムも提供しています。

まとめ

- AI倫理5原則:人間中心・公平性・透明性・安全性・責任

- AIの判断を最終決定にせず、人間が責任を持って監督する

- AIを使用していることを適切に開示し、透明性を保つ

- 組織としてのガイドライン策定と継続的な教育が重要

よくある質問

Q. AIで作成したコンテンツを公開するとき、必ず「AI使用」と書く必要がありますか?

A. 法的義務がある場合とそうでない場合があります。現時点の日本では、多くのケースで法的義務はありませんが、読者・視聴者の信頼を得るためには開示が望ましいです。特に、専門的な情報(医療・法律・金融など)、ジャーナリズム、学術論文などでは、AI使用の開示が強く推奨されます。

Q. 会社でAIを使うとき、どんな情報を入力してはいけませんか?

A. 一般的に避けるべきは、①顧客の個人情報、②社外秘・機密情報、③未公開の財務情報、④従業員の個人情報、⑤契約で守秘義務がある情報、です。会社のAI利用ガイドラインを確認し、不明な場合は情報システム部門や法務部門に相談してください。

Q. AIの回答に偏りがあるかどうか、どうやって見分けますか?

A. ①同じ質問を別の表現で聞いてみる、②反対の立場からの意見も聞いてみる、③「この回答に反論はありますか?」と追加質問する、④複数のAIツールで比較する、といった方法が有効です。特定の属性(性別、年齢、国籍など)に関する回答は、特に注意深く検証してください。

Q. AIが間違った情報を出力した場合、誰の責任になりますか?

A. 基本的には、AIの出力を採用・公開した人間(または組織)に責任があります。「AIが間違えた」は免責理由になりません。これが「責任(Accountability)」の原則です。だからこそ、AIの出力を検証し、最終判断は人間が行うことが重要なのです。